Utilizar ChatGPT no es Malo para el Medio Ambiente

Y un llamamiento a pensar seriamente en el cambio climático sin distraerse: Parte 1.

Utilizar ChatGPT no es Malo para el Medio Ambiente (Parte 1)

Por: Andy Masley, director de EA DC.

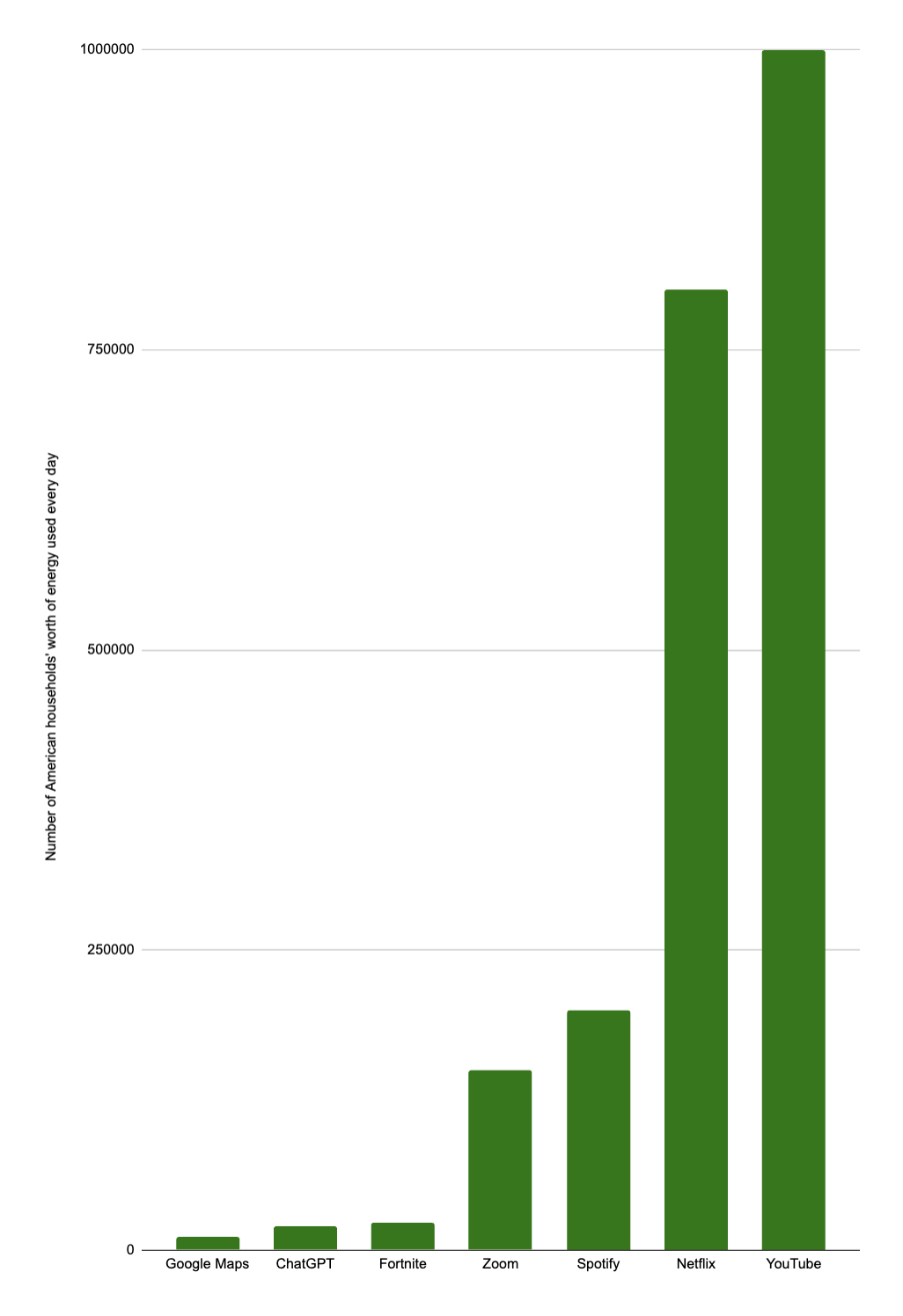

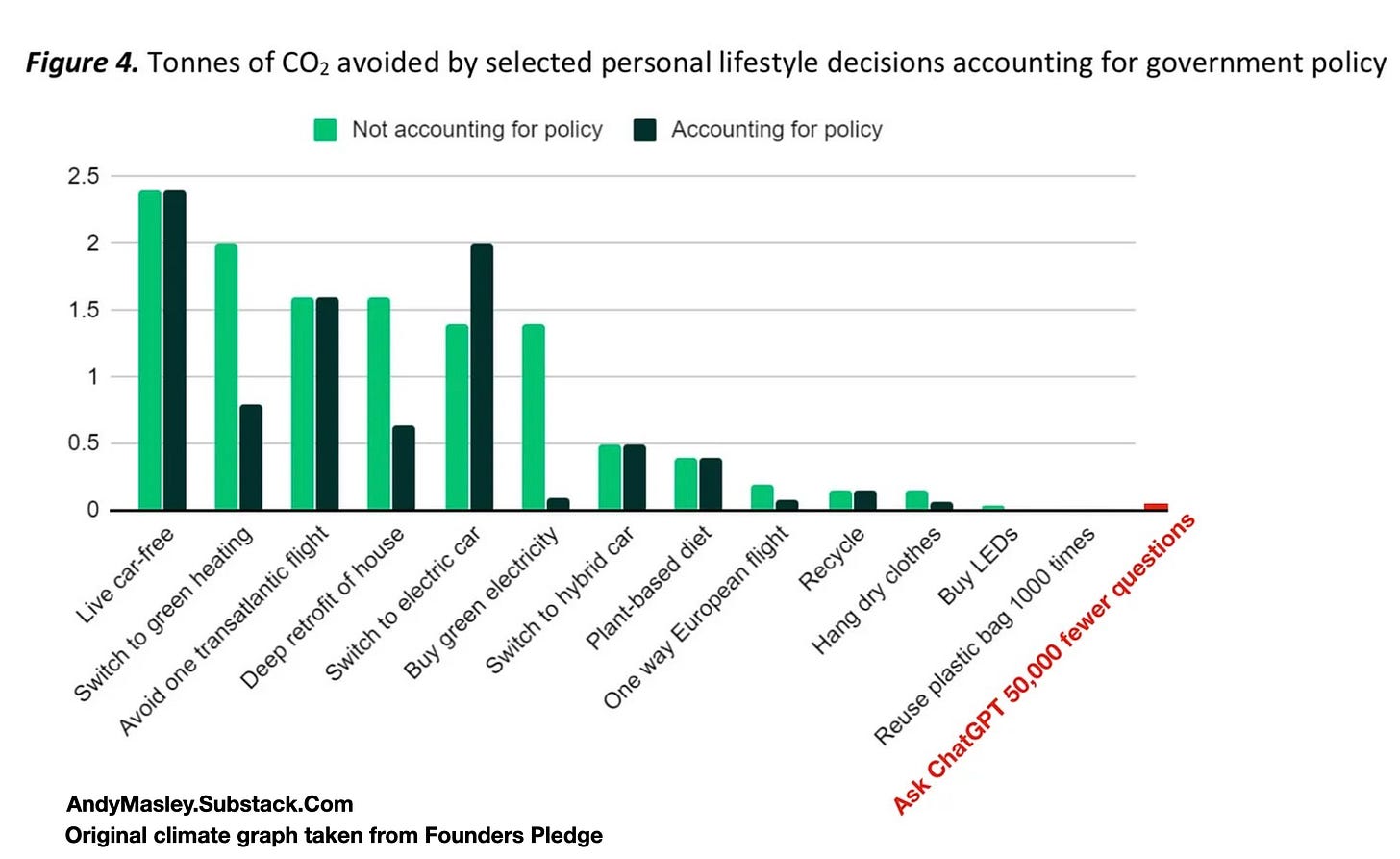

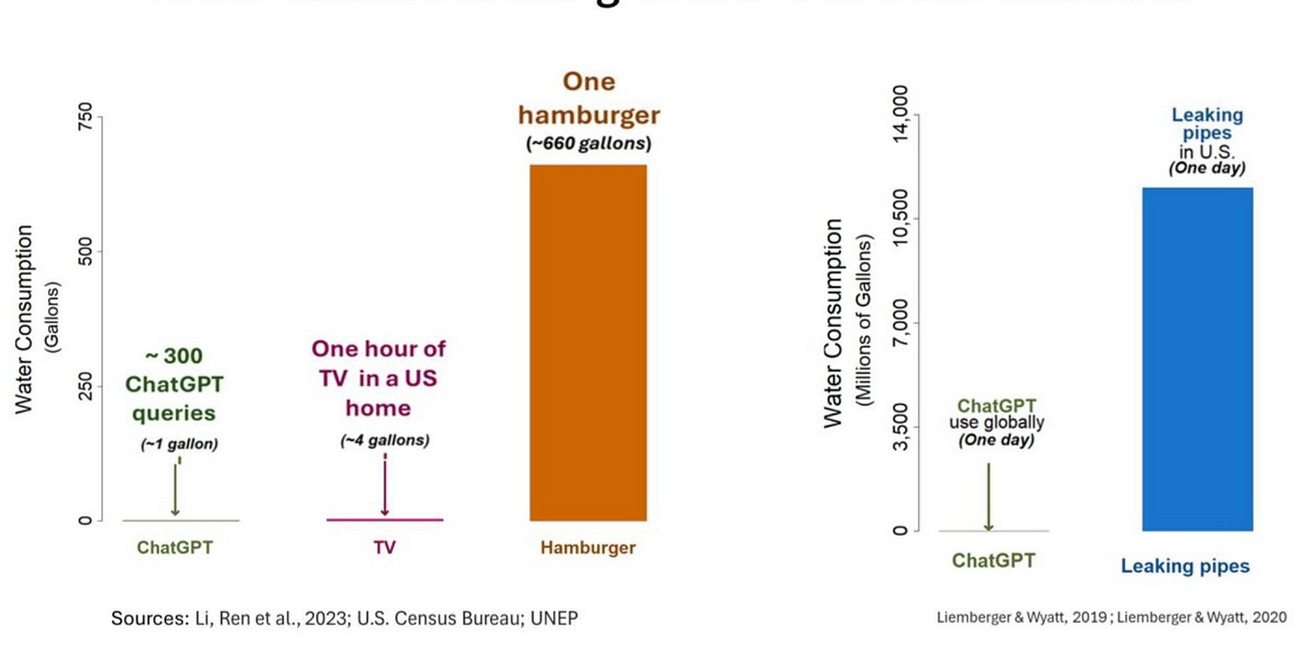

Si no tienes tiempo de leer este post, estos cuatro gráficos dan la mayor parte del argumento. Cada uno incluye tanto el coste de energía/agua de utilizar ChatGPT en el momento como el coste amortizado de entrenar GPT-4:

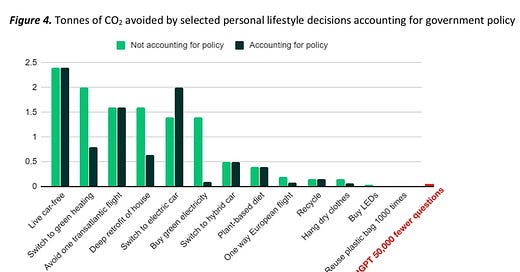

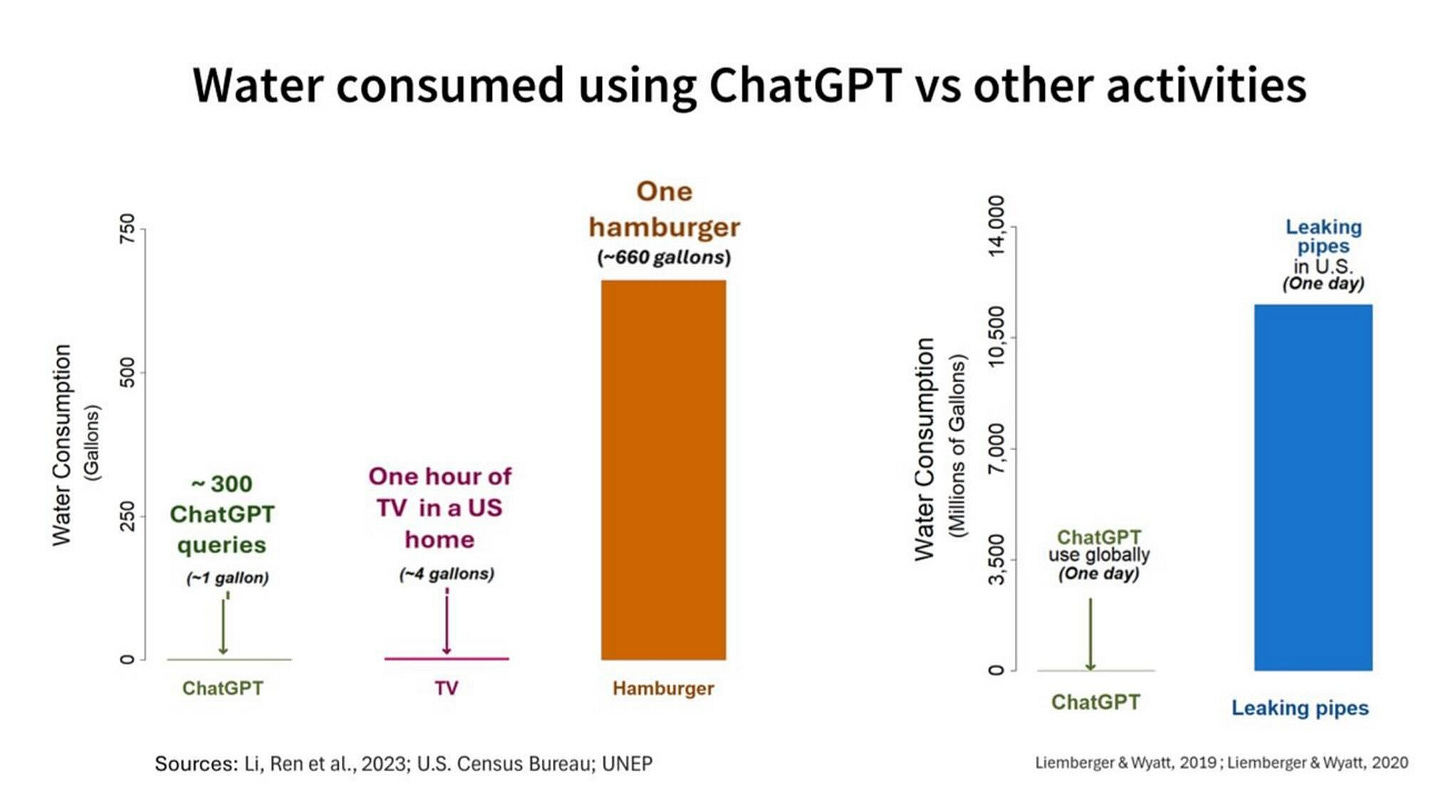

Fuente del gráfico original. Cada barra aquí representa 1 año de la actividad, por lo que la barra vivir sin coche representa vivir sin coche sólo 1 año, etc. La cifra de ChatGPT supone 3 Wh por búsqueda multiplicados por las emisiones medias por Wh en EEUU. Incluir el coste de la formación elevaría la energía utilizada por búsqueda en un 10% aproximadamente, a 3,3 Wh, lo que no crearía un cambio visible en el gráfico.

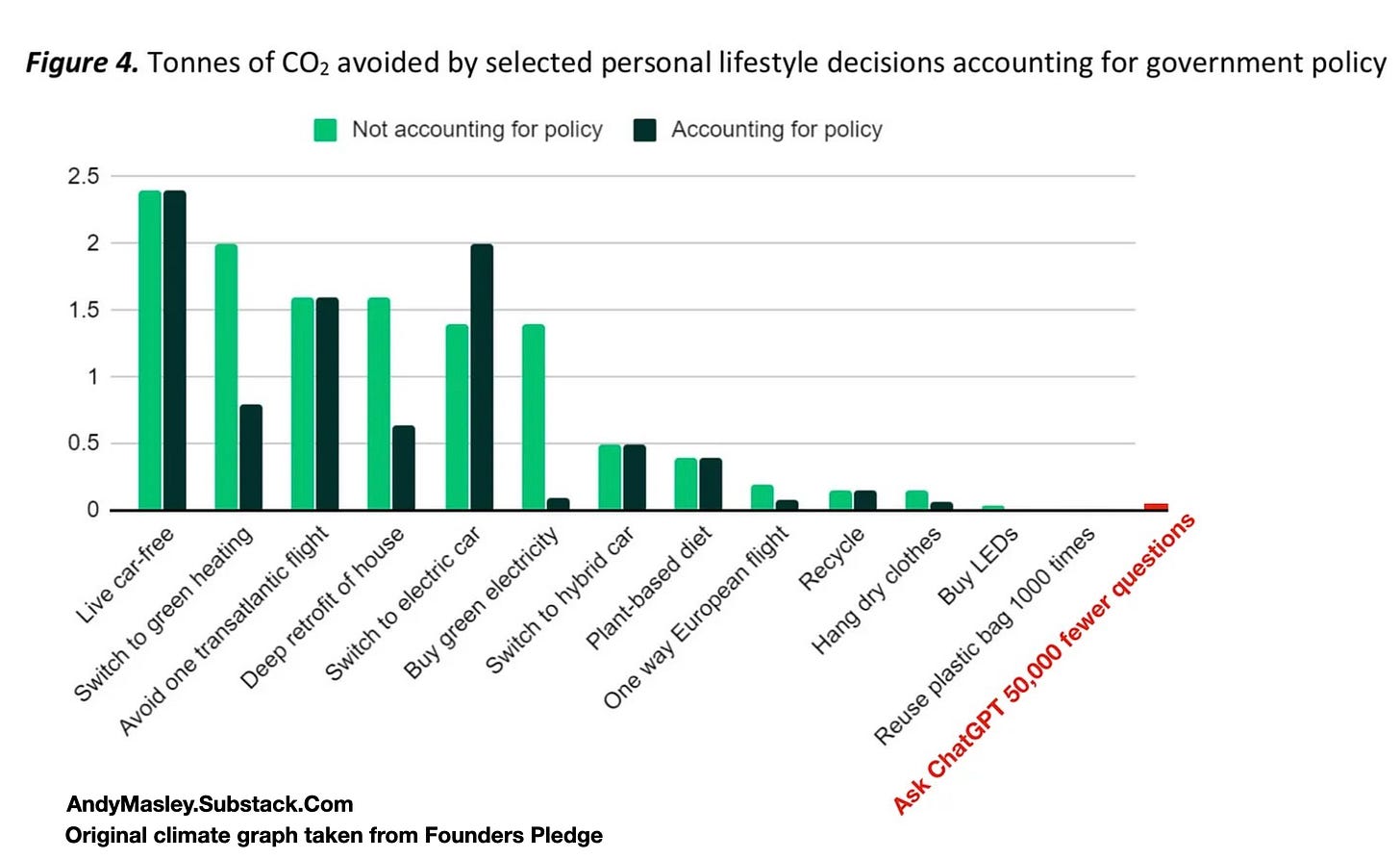

Obtuve estas cifras multiplicando la tasa media de agua utilizada por kWh utilizado en los centros de datos + la tasa media de agua utilizada generando la energía por la energía utilizada en los centros de datos por las diferentes tareas. El coste del agua para entrenar GPT-4 se amortiza en el coste de cada búsqueda. Este es el mismo método utilizado para estimar originalmente el agua utilizada por una búsqueda ChatGPT. Ten en cuenta que el agua «utilizada» por los centros de datos es ambigua en general, lee más en esta sección.

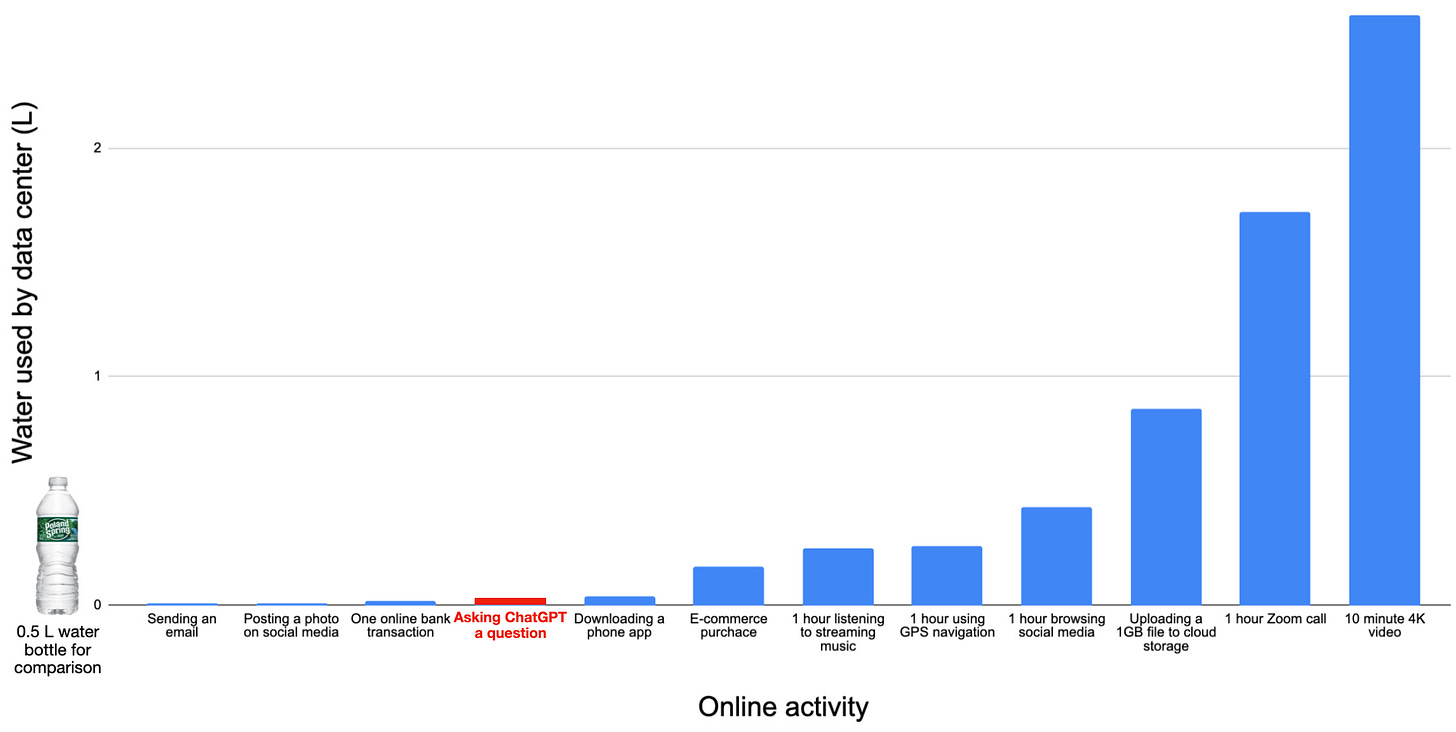

Estadística para una búsqueda ChatGPT, hamburguesa, y tuberías con fugas

Obtuve estas cifras a partir de cálculos aproximados utilizando datos disponibles públicamente sobre cada servicio. Si crees que están equivocados, ¡me encantaría actualizarlos! Como esto se basa en la energía total utilizada por un servicio que está creciendo rápidamente, va a quedar desfasado rápidamente.

Introducción

Este post trata de por qué no es malo para el medio ambiente que tú o un número cualquiera de personas utilicéis ChatGPT, Claude u otros grandes modelos lingüísticos (LLM). Puedes utilizar ChatGPT tanto como quieras sin preocuparte de que estés haciendo un daño significativo al planeta. Preocuparte por tu uso personal de ChatGPT es una pérdida de tiempo que podrías dedicar a los graves problemas del cambio climático. Este post no trata de los impactos climáticos más amplios de la IA en su conjunto, ni de si los LLM no son éticos por otras razones (derechos de autor, alucinaciones, riesgos de la IA avanzada, etc.).

Si crees que me estoy equivocando en algo, te agradecería mucho que lo dijeras, ya sea en los comentarios o en algún otro lugar donde pueda leerlo.

¿Por qué escribir esto?

No suelo estar interesado en escribir simples posts de desacreditación, pero hablo y leo con regularidad sobre el debate en torno a las emisiones causadas por el uso individual de la IA y me resulta totalmente evidente que una de las partes está entendiendo las cosas de forma totalmente errónea y difundiendo ideas engañosas. Estas ideas se han extendido tanto que me topo con ellas constantemente, pero no he encontrado un buen resumen que explique por qué están equivocadas, así que voy a elaborar uno.

En las últimas fiestas a las que he asistido he mencionado de pasada que utilizo ChatGPT, y en todas ellas alguien a quien no conozco ha dicho algo como «Ew... ¿usas ChatGPT? ¿No sabes lo terrible que es para el planeta? Y sólo produce bazofia». También he visto muchas publicaciones populares en Twitter que anuncian con confianza que es malo utilizar IA porque está quemando el planeta. Los puntos comunes de estas conversaciones y publicaciones son:

Cada búsqueda ChatGPT emite 10 veces más que una búsqueda Google.

Una búsqueda ChatGPT utiliza 500 ml de agua.

ChatGPT en su conjunto emite tanto como 20.000 hogares estadounidenses al día. Utiliza tanta agua como 200 piscinas olímpicas al día.

Entrenar un modelo de IA emite tanto como 200 vuelos de avión de Nueva York a San Francisco.

La única afirmación incorrecta de esta lista es el punto de los 500 ml de agua. Se trata de un malentendido de un informe original que decía que se utilizan 500 mL de agua por cada 20-50 búsquedas en ChatGPT, no por cada búsqueda. Incluso esa cifra creo que es engañosa (se explica aquí) y la cantidad de agua que realmente fluye en los centros de datos es más bien de 500 mL de agua por cada 300 búsquedas. Todas las demás afirmaciones de esta lista son ciertas, pero también ofrecen una imagen drásticamente inexacta de las emisiones producidas por ChatGPT y otros LLM y de cómo se comparan con las emisiones de otras actividades. No se trata de errores menores: malinterpretan fundamentalmente el uso de la energía y corren el riesgo de distraer al movimiento climático.

Uno de los cambios más importantes a la hora de hablar del clima ha sido la comprensión colectiva de que acciones individuales como el reciclaje palidecen en comparación con la necesidad urgente de hacer la transición del sector energético a la energía limpia. El actual debate sobre la IA parece como si hubiéramos olvidado esa lección. Tras años de progreso en el tratamiento de los problemas sistémicos por encima de los cambios en el estilo de vida personal, es como si de repente todo el mundo empezara a obsesionarse con si los relojes digitales de nuestros dormitorios consumen demasiada energía y empezara a condenarlos como un problema importante.

Por otra parte, los LLM han supuesto para mí una mejora vital increíble. Me he dado cuenta de que la mayoría de la gente que no ha jugado mucho con ellos no sabe lo poderosos que han llegado a ser ni lo útiles que pueden resultar en tu vida cotidiana. Son la primera pieza de nueva tecnología en mucho tiempo que he insistido en que pruebe absolutamente todo el mundo. Si no las utilizas porque te preocupa el impacto medioambiental, creo que te han engañado y te has perdido una de las nuevas tecnologías más útiles (y científicamente interesantes) de mi vida. Si la gente del movimiento climático deja de utilizarlas, perderá mucho valor potencial y capacidad de aprender rápidamente. Sería una pena.

En un nivel meta, hay una suposición de fondo sobre cómo se supone que hay que pensar sobre el cambio climático que me ha agotado, y de la que está inundada la conversación sobre las emisiones de IA. La mala suposición es

Para pensar y comportarte bien sobre el clima tienes que identificar a unos cuantos actores/instituciones individuales malos y sobre todo odiarlos y no utilizar sus productos. No te preocupes demasiado por los números o las compensaciones complejas u otros aspectos de tu propio estilo de vida. Identifica a los malos y actúa en consecuencia.

El cambio climático es un problema demasiado complejo, importante e interesante como para actuar siguiendo esta regla. Cuando la gente se me queja de las emisiones de la IA, suelo interpretar que me dicen: «Soy una buena persona que ha hecho su parte y ha identificado al malo. Si tú no odias también al malo, eres sospechoso». Es una forma de pensar que mata la mente. Utilizo este post, en parte, para demostrar cómo preferiría pensar sobre el clima: observamos fríamente las cifras, las instituciones y los actores sobre los que podemos influir colectivamente y respondemos en función de dónde tendremos realmente el efecto más positivo sobre el futuro, no en función de a quién damos estatus en el proceso. No me inclino por dar estatus a las empresas de IA. Gran parte de mi trabajo consiste en hacer que la gente se preocupe más por la IA en otros ámbitos. Lo que quiero es que la gente reaccione realmente ante las realidades del cambio climático. Mi afirmación en este post es que si te preocupa en absoluto que tu propio uso de la IA contribuya al cambio climático, te han engañado para que construyas monstruos en tu cabeza y tienes que espabilar.

La situación climática ya es suficientemente mala. No hagamos esto.

¿Cómo debemos pensar en la ética de las emisiones?

He aquí algunos supuestos que guiarán el resto de este post:

Intentas reducir tus emisiones individuales

Si no intentas reducir tus emisiones, de todos modos no te preocupa el impacto climático del uso individual de LLM. Asumiré que estás interesado en reducir tus emisiones y escribiré sobre si es aceptable utilizar LLM.

Se puede argumentar que las personas que se preocupan por el cambio climático deberían dedicar mucho menos tiempo a preocuparse por cómo reducir sus emisiones individuales y mucho más a pensar en cómo provocar un cambio sistemático para mejorar nuestros sistemas energéticos (los efectos que tú, como individuo, puedes tener en nuestro sistema energético a menudo empequeñecen completamente los efectos que puedes tener a través de tus elecciones individuales de consumo), pero éste es un tema para otro post.

La cantidad óptima de CO2 que emites no es cero

Nuestro sistema energético depende tanto de los combustibles fósiles que los individuos no pueden eliminar todas sus emisiones personales. Detener inmediatamente todas las emisiones globales de CO2 causaría miles de millones de muertes. Tenemos que eliminar gradualmente las emisiones mediante la transición a energías limpias y haciendo concesiones en el uso de la energía. Si todas las personas preocupadas por el cambio climático adoptaran hoy un estilo de vida sin emisiones, muchas de ellas morirían. El resto perdería el acceso a la mayor parte de la sociedad moderna, quedando impotentes para influir en los sistemas energéticos. Los negacionistas del clima se apoderarían de la sociedad. Vivir individualmente con cero emisiones no es factible ahora mismo.

Para decidir qué recortar, debemos tener en cuenta tanto cuánto emite una actividad como lo útil y beneficiosa que es para nuestras vidas. No debemos recortar una actividad basándonos únicamente en sus emisiones.

Un hospital infantil medio emite más CO2 al día que un crucero medio. Si siguiéramos la regla «Cortar primero a los que más emiten», daríamos prioridad a cortar los hospitales sobre los cruceros, lo que es claramente una mala idea. Reducir las emisiones exige sopesar el valor de algo frente a sus emisiones, no recortar ciegamente basándonos sólo en la producción de CO2. Deberíamos hacernos preguntas como «¿Podemos conseguir el mismo resultado con menos emisiones?» o «¿Es necesaria esta actividad?». Pero la regla «Encuentra lo que más emite en un grupo de actividades y córtalo» no funciona.

En este post, compararé el uso de los LLM con otras actividades y recursos de utilidad similar. Si crees que los LLM son totalmente inútiles, entonces deberíamos dejar de utilizarlos, pero yo estoy convencido de que son útiles. Parte de este post explicará por qué.

Es extremadamente malo distraer al movimiento climático con debates sobre niveles intrascendentes de emisiones

Si el cambio climático es una emergencia que requiere que mucha gente trabaje colectivamente para solucionarlo en un tiempo limitado, no podemos permitirnos distraernos centrando demasiado nuestro esfuerzo y pensamiento en niveles de emisiones extremadamente pequeños. El movimiento por el clima ha progresado mucho y ha tenido mucho éxito al cambiar su enfoque de las acciones individuales, como apagar las luces al salir de una habitación, a los grandes cambios sistemáticos, como la construcción de infraestructuras de redes inteligentes o la financiación de tecnologías de energía limpia. Incluso si sólo te centras en los cambios de estilo de vida, es mejor que te centres en los cambios de estilo de vida más impactantes para el clima. Sería mucho mejor que los activistas climáticos dedicaran todo su tiempo a ayudar a la gente a cambiar a la calefacción ecológica que a animar a la gente a tender la ropa. Si el movimiento climático no debe centrar sus esfuerzos en conseguir que la gente se ponga a secar la ropa, tampoco debe centrarse en convencer a la gente de que no utilice ChatGPT:

Fuente del gráfico original. Cada barra representa aquí 1 año de actividad, por lo que la barra vivir sin coche representa vivir sin coche sólo 1 año, etc. La cifra de ChatGPT supone 3 Wh por búsqueda multiplicado por las emisiones medias por Wh en EEUU. Incluir el coste de la formación elevaría la energía utilizada por búsqueda en un 10% aproximadamente, hasta 3,3 Wh, lo que no crearía un cambio visible en el gráfico.

Hay otros problemas medioambientales además de las emisiones

Otra preocupación común sobre los LLM es su consumo de agua. Esto es importante aunque no sea una causa directa del cambio climático. Lo trataré en la segunda parte del post. Es posible que también haya otras preocupaciones (las cadenas de suministro implicadas en la construcción de centros de datos en primer lugar), pero por lo que sé, otras preocupaciones medioambientales también se aplican básicamente a todos los ordenadores y teléfonos, y no veo a mucha gente diciendo que tenemos que dejar de utilizar inmediatamente nuestros ordenadores y teléfonos por el bien del clima. Si crees que hay otros malos resultados medioambientales de los LLM que estoy pasando por alto en este post, ¡me encantaría conocerlos en los comentarios!

Es imposible obtener mediciones muy precisas de cuánta energía consumen exactamente los individuos que utilizan sistemas complejos extremadamente grandes

Cualquier estadística sobre el consumo de energía de las actividades individuales de Internet tiene grandes barras de error, porque Internet es tan gigantesco y el consumo de energía se reparte entre tantos dispositivos. Todas las fuentes que he utilizado han llegado a estas cifras dividiendo un número incierto muy grande por otro. He hecho todo lo posible por presentar las cifras tal como existen en los datos públicos, pero debes suponer que hay barras de error significativas en cualquier dirección. Lo que importa son las proporciones más que los números muy concretos. Si crees que alguna de las estadísticas que utilizo aquí es incorrecta, te agradecería mucho que me lo hicieras saber en los comentarios. Estoy deseando actualizar este post con las cifras más fiables que pueda conseguir.

¿Son útiles los LLM?

Si los LLM no son útiles en absoluto, cualquier emisión, por ínfima que sea, no merece la pena, así que deberíamos dejar de utilizarlos. Este post depende de que los LLM sean al menos un poco útiles, así que voy a exponer el caso aquí.

Creo que mi mejor argumento para explicar por qué los LLM son útiles es que juegues con Claude o ChatGPT e intentes hacerle preguntas difíciles sobre hechos concretos para las que has estado intentando obtener respuestas. Experimenta con las indicaciones que le das y comprueba si haciéndole preguntas muy concretas con peticiones sobre cómo te gustaría que se enmarcara la respuesta (viñetas, párrafo tipo libro de texto) consigues lo que quieres. Prueba a subir un texto complicado que estés intentando comprender y utiliza la pregunta «¿Puedes resumirlo y definir los términos que resulten desconocidos para un novato en la materia?». Prueba a pedirle ayuda con un problema técnico complicado que estés tratando en el trabajo.

Si quieres testimonios de otras personas, puedes leer los relatos de otras personas sobre cómo utilizan los LLM. Aquí tienes uno bueno. Aquí tienes otro. Este artículo es una gran introducción a todo lo que pueden hacer los LLM actuales.

Los LLM no son perfectos. Si lo fueran, el mundo sería muy extraño. La existencia de inteligencia de nivel humano en los ordenadores llevaría a que ocurrieran cosas muy extrañas. Google tampoco es perfecto y, sin embargo, la mayoría de la gente saca mucho provecho de su uso. Recibir respuestas malas o incorrectas de un LLM es de esperar. La tecnología está intentando recrear una conversación de alto nivel con un experto en todos y cada uno de los dominios del conocimiento humano. Debemos esperar que falle ocasionalmente.

Personalmente, los LLM me parecen mucho más útiles como herramienta de aprendizaje que la mayor parte de lo que existe en Internet, aparte de artículos específicos de alta calidad. La mayor parte del contenido de Internet no es la Enciclopedia Stanford de Filosofía, ni la Wikipedia. Si quiero entender un tema nuevo, a menudo me resulta mucho más útil leer un resumen de ChatGPT que ver una hora de algunos de los mejores contenidos de YouTube sobre el tema. Puedo hacer preguntas aclaratorias muy concretas sobre un tema que me llevaría mucho tiempo buscar en Internet.

Argumento principal

Emisiones

¿Cuál es la forma correcta de pensar sobre las emisiones LLM? Algo sospechoso que hacen muchas afirmaciones sobre los LLM es compararlos con objetos físicos del mundo real y sus emisiones. Cuando se habla del uso global de ChatGPT, se hacen muchas comparaciones con coches, aviones y hogares. Otro movimiento sospechoso es compararlos con actividades online habituales que normalmente no salen a relucir en las conversaciones sobre el clima (¿cuándo fue la última vez que oíste a un científico del clima mencionar las búsquedas en Google como una causa importante de las emisiones de CO2?) La razón por la que esto es sospechoso es que a la mayoría de la gente le faltan tres intuiciones clave:

Sin estas intuiciones, es fácil que cualquier estadística sobre la IA parezca una catástrofe ridícula. Exploremos cada una de ellas en el siguiente artículo sobre el impacto medioambiental de usar ChatGPT:

¿Cómo podemos reducir el impacto medioambiental de la IA?

Una forma de abordar esta cuestión es abogar por una mayor transparencia en el desarrollo y funcionamiento de los sistemas de aprendizaje automático. Los científicos han desarrollado marcos para ayudar a los investigadores a informar sobre su consumo de energía y carbono, con la esperanza de promover la rendición de cuentas y las prácticas responsables en este campo. Para ayudar a los investigadores a evaluar su uso de la energía, algunos científicos han publicado herramientas en línea que animan a los equipos a realizar experimentos en zonas respetuosas con el medio ambiente, a proporcionar actualizaciones coherentes sobre las mediciones de energía y carbono, y a evaluar activamente las compensaciones entre el uso de la energía y el rendimiento antes de desplegar modelos de alto consumo energético.

Los individuos también tienen un papel crucial que desempeñar en la promoción de una mayor responsabilidad en la IA. Una forma de hacerlo es reducir la exageración en torno a los nuevos y llamativos sistemas de IA, como ChatGPT, y reconocer las limitaciones de los modelos lingüísticos. Al situar sus logros en su contexto y reconocer las compensaciones que implican, podemos fomentar activamente nuevas vías de investigación que no se basen únicamente en el desarrollo de modelos más grandes y complejos. Este enfoque no sólo promueve prácticas responsables en la IA, sino que también allana el camino hacia una IA «más verde».

Se calcula que ChatGPT emite 8,4 toneladas de dióxido de carbono al año, más del doble de la cantidad emitida por un individuo, que es de 4 toneladas al año. Por supuesto, el tipo de energía utilizada para hacer funcionar estos centros de datos afecta a la cantidad de emisiones producidas -las centrales eléctricas de carbón o gas natural producen emisiones mucho mayores que la energía solar, eólica o hidroeléctrica-, por lo que es difícil proporcionar cifras exactas.

Un estudio reciente de investigadores de la Universidad de California, Riverside, reveló la importante huella hídrica de modelos de IA como ChatGPT-3 y 4. El estudio informa de que Microsoft utilizó aproximadamente 700.000 litros de agua dulce para entrenar el GPT-3 en sus centros de datos, lo que equivale a la misma cantidad de agua utilizada para fabricar 370 coches BMW o 320 vehículos Tesla. Esto se debe principalmente al proceso de entrenamiento, que consume y convierte grandes cantidades de energía en calor, lo que requiere una cantidad asombrosa de agua dulce para mantener las temperaturas bajo control y enfriar las máquinas. El modelo también consume una cantidad significativa de agua en el proceso de inferencia, que se produce cuando ChatGPT se utiliza para tareas como responder preguntas o generar texto. Para una simple conversación de 20-50 preguntas, el agua consumida equivale a una botella de 500 ml, lo que hace que la huella hídrica total para la inferencia sea significativa si se tienen en cuenta los miles de millones de usuarios.